France : un adolescent de 15 ans convoqué par la police après une conversation avec ChatGPT

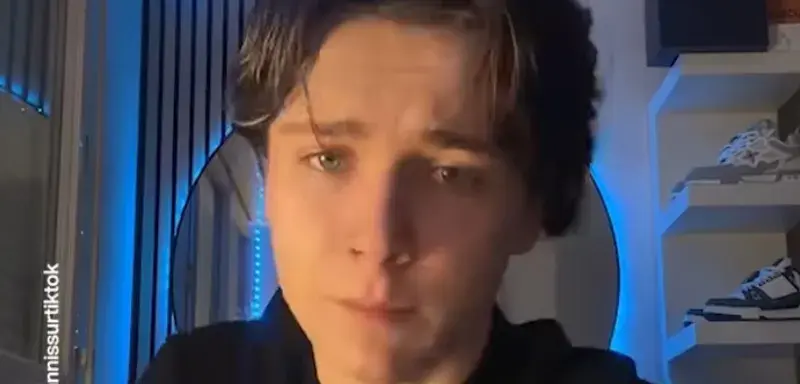

Un adolescent français prénommé Yannis, âgé de 15 ans, a récemment été convoqué par la police après une conversation jugée inquiétante avec le chatbot ChatGPT. Cette affaire, devenue virale sur les réseaux sociaux, illustre la nouvelle réalité de la surveillance des intelligences artificielles et soulève des questions sur la vie privée numérique des mineurs.

Selon les témoignages circulant sur TikTok et Instagram, le jeune homme aurait testé ChatGPT avec des requêtes morbides, évoquant notamment un scénario de « cadavre dans la cave ». Ces échanges auraient été détectés par les systèmes de surveillance d'OpenAI, déclenchant une alerte aux autorités françaises.

L'adolescent a finalement été convoqué au commissariat pour s'expliquer sur ses intentions. Si les détails précis de l'affaire restent confidentiels, cette convocation marque un tournant dans la manière dont les autorités appréhendent les interactions entre mineurs et intelligences artificielles.

OpenAI surveille vos conversations et peut alerter la police

Cette affaire met en lumière une politique méconnue d'OpenAI. La société américaine a en effet confirmé qu'elle scanne les conversations de ses utilisateurs et peut, dans certains cas, les transmettre aux forces de l'ordre. « Quand nous détectons des utilisateurs qui planifient de faire du mal à autrui, nous acheminons leurs conversations vers des équipes spécialisées qui sont autorisées à prendre des mesures, y compris bannir des comptes », explique OpenAI dans sa politique d'utilisation.

Le processus est précis : lorsqu'un contenu est jugé préoccupant, il est d'abord signalé en interne. Des modérateurs humains, formés aux politiques de l'entreprise, examinent alors l'échange. « Si les évaluateurs estiment qu'il existe une menace imminente de violence physique grave envers autrui, nous pouvons transmettre l'affaire aux autorités », précise le géant de l'intelligence artificielle.

Sam Altman, le PDG d'OpenAI, a d'ailleurs averti les utilisateurs que leurs conversations avec ChatGPT « n'ont aucune confidentialité légale et pourraient être utilisées comme preuves devant un tribunal ».

Des précédents inquiétants aux États-Unis et en France

L'affaire Yannis n'est pas isolée. En octobre 2025, un adolescent américain de 13 ans avait été arrêté en Floride après avoir demandé à ChatGPT « comment tuer mon ami en plein cours ». Sa requête avait été immédiatement détectée par Gaggle, un système de surveillance déployé dans les établissements scolaires américains. L'élève avait été interpellé et conduit menotté dans un centre de détention pour mineurs.

En France, un cas bien plus grave avait secoué le pays en septembre 2025. Un lycéen de 17 ans du Mans avait été écroué pour association de malfaiteurs terroristes. Selon son avocat, Me Dylan Slama, « l'intelligence artificielle, et notamment ChatGPT, a eu une influence sur le comportement de mon client ». Le jeune homme avait utilisé le chatbot pour préparer des projets d'attentats contre un établissement scolaire de la Sarthe et un bâtiment public parisien.

Ces affaires témoignent d'une prise de conscience des autorités face aux risques liés à l'utilisation détournée des outils d'IA. Les parents sont désormais appelés à surveiller les interactions de leurs enfants avec ces technologies, tandis que les entreprises renforcent leurs dispositifs de détection. Une nouvelle ère de la surveillance numérique s'ouvre, où même les conversations avec une intelligence artificielle peuvent mener au commissariat.